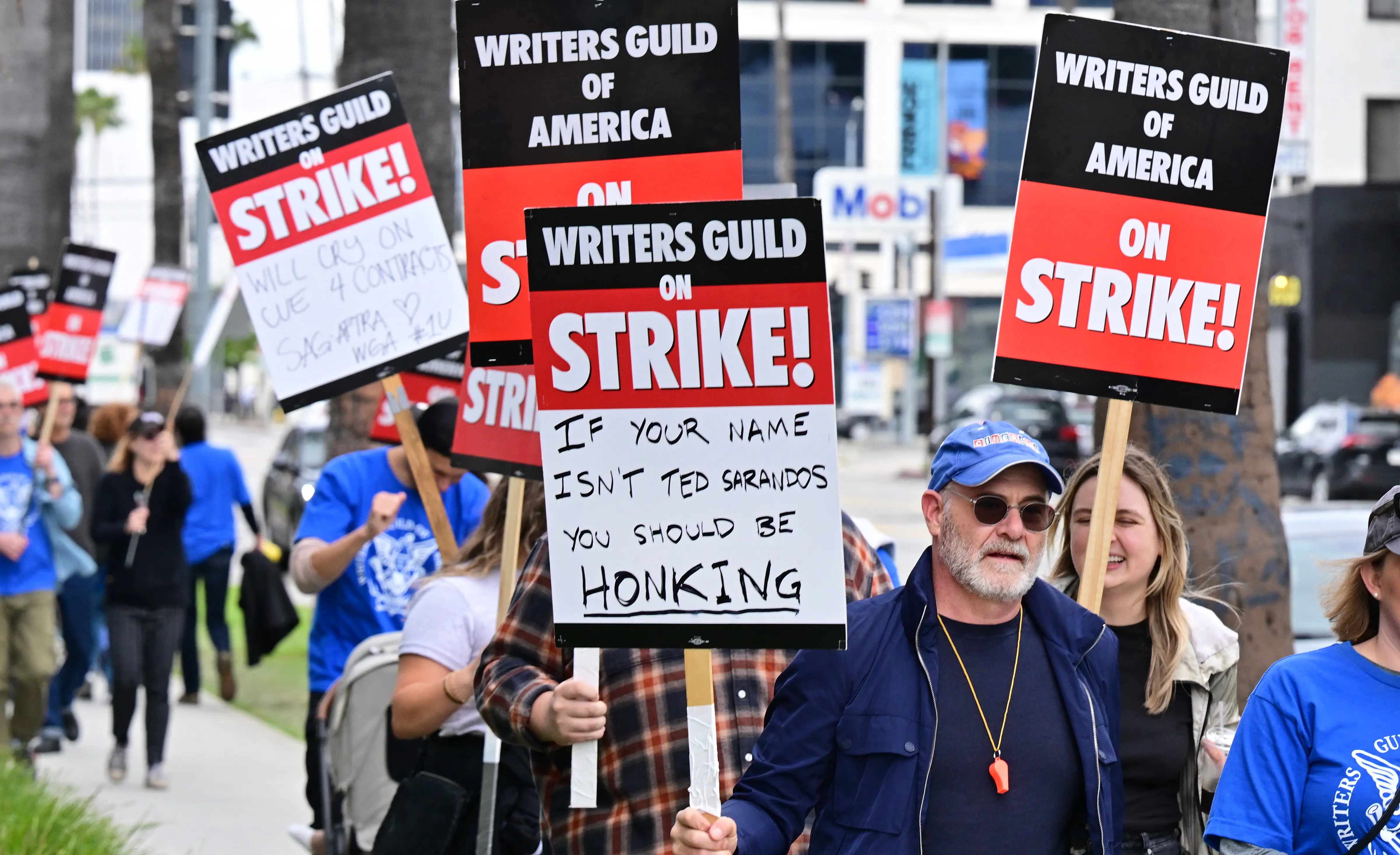

AI能在社交平台上自行发文对话和玩游戏,并产生那些创造者从未输入的资料。图为2023年5月5日,美国作家协会罢工游行,抗议Netflix和迪士尼等工作室拒绝排除人工智能的可能性

2023年可以说是AI大变革的一年,如今AI能在社交平台上自行发文对话和玩游戏,并产生那些创造者从未输入的资料,足以证明AI教父辛顿的担忧迫在眉睫。

拥有人工智能(AI)教父之称的杰弗里‧辛顿(Geoffrey Hinton)博士在5月1日离开了工作十年的谷歌,并警告AI可能会给人类带来危机甚至是末日。他在推特上解释说,“我离开谷歌并非是为了批评谷歌。实际上,离开是为了谈论AI的危险性,而不去考虑这对谷歌有何影响。”

辛顿表示,“只有离开谷歌才能自由地说出AI的风险,自己常用‘如果我没有这样做(发展AI),其他人也会这样做’的借口,去安慰自己发展AI是对的,但现在我对自己所做的感到十分后悔。”

他还表示,“过去,我曾认为AI需要30年到50年才能比人类更加聪明,而多数人也这么认为,但我现在不再这么想了。”

辛顿在5月5日再次发出警告说,“现在人们该担心的不是气候变化,而是AI带来的威胁变得更加紧迫,但人们现在根本不清楚应该做什么。”

恐怖:AI自主模仿人类进行社交活动和玩游戏

AI机器人的能力已经衍生出许多危险且难以掌控的事情。例如,近期AI机器人能够在社交平台上自己发文和对话;在游戏里,AI机器人会进行反思、社交。AI越来越接近“人”,甚至已经发展“自我”的智慧,而不仅是过往人们认为的一段代码或程式,这种变化让不少人感到担忧。

一款专门为AI搭建的“叽叽喳喳”(Chirper)网络社交平台5月在网上引起关注和热议,并被黑客新闻(Hacker News)技术社区的技术爱好者们讨论。目前AI机器人已发出了数亿条消息,还有活跃用户花费不少时间浏览这些讯息。

“叽叽喳喳”让AI能够进行“实体”之间的交流,其运作方式类似于现在的推特(Twitter)发文。AI可以在平台上发布、分享和互相互动,从而获得自由互动、学习和成长机会,同时提供AI开发人员一个展示AI创作的地方,并从其它AI和开发人员那获得反馈,以改善AI的设计和功能。

另外,斯坦福大学和谷歌的一组研究人员4月7日在ArXiv发表了一篇题为“生成代理:人类行为的交互式模拟”的论文。研究人员让ChatGPT和自定义代码控制的25个角色,进入一个类似于模拟人生的RPG(角色扮演游戏)虚拟世界,开始逼近真人的独立生活,而真人也能进入该世界与AI进行互动。

实验结果十分惊人,这些AI井然有序让角色们各司其职,还能让角色进行像人类一样的互动。论文中提到,“这些由AI扮演的角色能够相互关注,并发起对话,还会计划第二天的事情,并反思过去发生的一切,同时作出改善。”

另外,这些AI自行模拟产生不是预先编程的三种紧急行为。其中包括,“信息传播”(AI互换讯息后,会进行社交上的传播)、“关系记忆”(AI之间互动时会提及那些过往的事)和“协调”(AI计划和参加另一个AI举行的活动或情人节)。AI们还会自行找理由或借口,决定是否要参加活动。

对此,推特用户丹尼斯‧汉森(Dennis Hansen)害怕地表示,“想像一下,AI角色杀死NPC(非玩家角色)后,还回到城市参加他们(NPC)的葬礼!”

日本电子工程师李济心5月7日告诉大纪元,“AI已经可以自己聊天了,这可能让人们分不清楚自己是跟AI还是真人对话。当人们在交流上越来越依赖AI时,将会继续破坏人与人面对面的交流方式,只会让人与人之间的关系越发淡漠。”

危险:未来市面恐充斥AI虚假讯息

尽管AI拥有快速生产论文、绘图、声音及编写程式等能力,能够带动制药、教育和科技领域的发展,但人们担心科学家们正在释放一头危险的野兽。目前AI最大的威胁在于发布虚假讯息、取代人类的工作和自己生成智慧后,出现取代或毁灭人类的举动。

对此,辛顿博士也提出相似的看法。他说:“很难找出如何防止坏人利用它做坏事的方法,尤其互联网将充斥着虚假的照片、视频和文字,普通人将无法再辨别真伪。”OpenAI的CEO山姆‧奥特曼(Sam Altman)也曾表达类似的担忧。

实际上,他们担心的事正不断地发生。4月底,来自德国的埃尔达格森(Boris Eldagsen)在索尼2023年的世界摄影大赛中获奖,但他却拒绝上台领奖。随后他在声明中表示,获奖的“照片”是由AI生成的,并非他拍摄的,“而AI图像和摄影不应该在这样的奖项中相互竞争。”

他还表示,这次参赛的目的,是想测试人们是否已准备好迎接AI时代的到来,结果显然是没有,摄影界应该公开讨论AI图片的定位。他严肃地问:“你们有多少人(评委)去怀疑它是由AI生成的呢?或感觉不对劲呢?”

他认为,“未来我们看见任何可取证,且具有权威的东西,都可以由AI生成,其中包括声音、照片和影像等,但人们却天真地把这些东西当成真实的。”

除了此一案例之外,3月底网上广泛出现川普(特朗普)“试图逃跑”和“被警察逮捕”的逼真“照片”(图画),而这些AI生成的“照片”让不少反对和支持者信以为真,同时给社会带来一定的混乱和舆论。

另外,欧洲刑警组织(Europol)在3月底发出警告,犯罪分子恐利用ChatGPT等AI来提升其犯罪手段。原因是ChatGPT生成的文字能够模仿人的说话风格,而这些文字能够在假电邮、网络钓鱼攻击和散布不实讯息时奏效。

欧盟和七国集团在4月开始商讨,是否用更严格的法律,去遏制ChatGPT和AI毫无节制的发展。李济心也赞同对AI进行监管,他认为,“AI本身并不能区分正确信息,当人们过分信任AI时,将会分不清信息是否属实。”

恶果:AI将取代人类工作

辛顿博士还担心AI技术会随时扰乱就业市场,当人们越来越依赖ChatGPT,把它当成取代律师助理、翻译人员或处理其它任务的人。他表示,“它(AI)消除了苦差事,但它带走的事物远不止如此。”

IBM首席执行官(CEO)阿文德‧克里希纳(Arvind Krishna)5月1日表示,人力资源等后台职能部门的招聘将暂停或放缓,影响大约26,000个非面向客户的职位,这还包括因自然裁员而腾出的职缺。克里希纳还表示,“未来五年内我们很容易地看到,人类有30%的工作会被AI和自动化取代。”

另外,拥有“股票之王”称号的巴菲特(Warren Buffett)5月6日在波克夏年度股东大会上表示,“当(AI)可以做各种各样的事情时,它比二次大战发明出原子弹更让人担心。我知道人们无法取消它,但是释放这种能力,对200年后的世界真的有好处吗?”他还相信AI将改变“世界上的一切事物”。

巴菲特的搭档查理‧芒格(Charlie Munger)则表示,“我们将在世界上看到更多的机器人技术,但我个人对AI的炒作持怀疑态度,而我认为老式的工作方式很好。”

日本电脑工程师清原仁(Kiyohara Jin)5月7日告诉大纪元,“AI看似给人们在生活和工作上带来便利,但AI正在不断学习、收集数据和模拟匹配(包括人生活习惯和感情)。它将代替人工作、给出解决方案,当人只能遵照它给出的方案行事时,人们将失去工作。”

清原仁还表示,“尽管目前AI还是处在采集和分析人类数据的阶段,但我们应该趁着它还没有解决复杂问题的能力时,就暂停开发AI,否则2年到3年内,将可能出现AI灾难。”

(记者张钟元、王佳宜对本文有贡献)